大模型技术飞速迭代,但企业级应用却面临一个尴尬的现实:模型越强大,输出的“不确定性”就越突出。一次AI幻觉,可能导致投放预算浪费、营销策略偏差,甚至损害品牌口碑。如何驯服大模型的“野性”?深演智能CTO欧阳辰在与执牛耳的对话中,详细拆解了企业级AI智能体平台DeepAgent 3.0的技术逻辑——不是要替代大模型,而是为其“套上缰绳”。

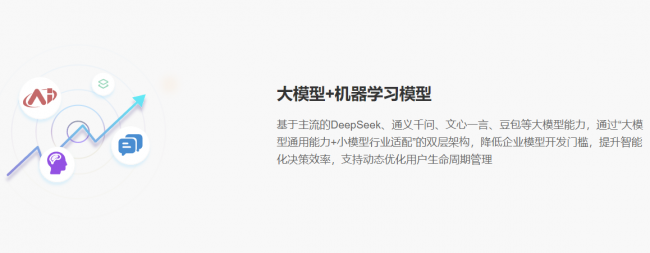

“大模型+小模型”双擎驱动,分工协同

欧阳辰用一个形象的比喻解释深演智能DeepAgent 3.0的核心架构:“大模型如同聪明的‘总指挥’,负责意图识别与自然语言交互;小模型则是精准的‘执行专家’,聚焦确定性决策执行。两者分工协同,共同完成复杂任务。”

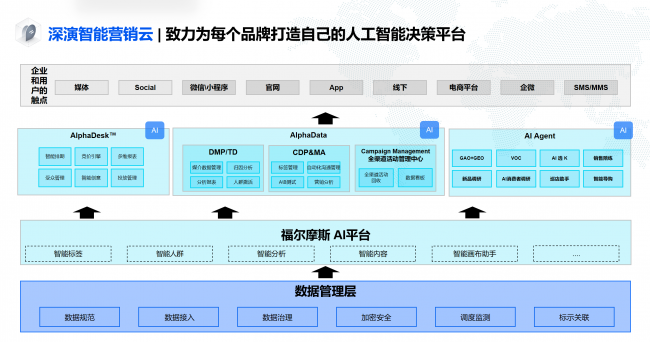

具体来看,当企业级AI智能体接收到一个营销任务(如“为某款新车策划预热活动”),大模型首先理解意图并将其拆解为人群圈选、内容生成、渠道规划等子任务。随后,系统动态调度对应的小模型——人群预测模型、内容生成模型、投放优化模型——去协同执行。这一过程既发挥了大模型的泛化能力,又依托深演智能16年积累的300+行业专属决策模型与5000+场景化模板,确保每个环节的精准与稳定。

三重技术手段,从源头对抗“幻觉”

“幻觉”是企业级AI最大的信任杀手。欧阳辰透露,深演智能DeepAgent 3.0从技术源头构建了一套组合拳:

一、调低模型“温度”参数,减少输出的随机性,从数学层面降低幻觉概率。 二、优化上下文工程,对冗长的对话历史进行“瘦身”和重组,仅保留关键信息,避免信息过载引发模型误判。 三、设置“技术围栏”与结果反思环节——所有由平台生成的指令,都会经过一套规范的查询语言校验,合格后方可执行,不合格则自动重新生成。这与To B领域对AI“可控、可追溯”的核心需求高度匹配。

数据保真:智能体的“生命线”

技术管控之外,深演智能认为,扎实的数据底座是AI可信赖的基石。欧阳辰强调:“数据保真就是让智能体所有决策和输出基于确定、真实、可溯源的数据,而不是凭空生成。”

深演智能DeepAgent 3.0依托公司十余年积累的一方数据与生态数据,结合内外部专家经验,构建起完善的行业知识库与智能体长期记忆。针对营销领域大量存在的社媒评论、客服语音等非结构化数据,平台有专门的工具进行标签化处理,将其转化为可被AI理解和调用的结构化数据。这些数据如同为“博士”配备的业务资料库,让它快速掌握企业的品牌调性与业务逻辑,让决策更有依据。

“白盒化”设计,让决策逻辑清晰可见

除了技术层面的管控,深演智能还强调“白盒化”交互设计。黄晓南在Morketing采访中举例说明:在用户运营旅程生成场景中,企业级AI智能体不会直接根据“提高复购”做全盘决策,而是将过程拆解为可验证的三步——先梳理历史最优运营因子,再用小模型做精准预测,最后将人群、内容、时间节点做匹配。每一步都能被业务人员复盘、调整。

这种设计让AI不再是“黑箱”,而是可解释、可干预的决策助手,极大增强了业务人员的信任感。

从“通用博士”到“业务专才”,深演智能DeepAgent 3.0的技术路径清晰可见:通过“大模型+小模型”的双引擎驱动,辅以全流程的幻觉管控、数据保真和白盒化设计,将AI的“想象力”锁定在企业业务需求的框架内。这不仅是技术架构的创新,更是对企业级AI智能体价值本质的深刻理解——在To B的世界里,“可靠”比“惊艳”更重要。